Interne KI

Wissensmanagement

Support & Beratung

Interner KI-Chat macht komplexes Sensorik-Wissen in Sekunden nutzbar

ME-Messsysteme entlastet wenige stark ausgelastete Expert:innen, indem ihr Wissen im internen KI-Chat breit verfügbar wird. Teams finden Produkt- und Fachwissen schnell und liefern Kunden sofort präzise Antworten. So sinken Weiterleitungen, und Anfragen werden direkt dort gelöst, wo sie ankommen.

Kunde

ME-Meßsysteme ist ein mittelständischer Technologieführer für 3D/6D-Kraft-Moment-Sensorik.

ME Meßsysteme ist ein mittelständischer Technologieführer für Sensorik und Auswerteelektronik mit eigenem Kalibrierlabor. Entwicklung und Fertigung erfolgen in Deutschland, nahe Berlin, am Standort Hennigsdorf. Die Produkte finden sich nahezu Überall z.B. zur Steuerung in Operationsrobotern, Robotern in hochautomatisierten Fertigungsstraßen sowie durch die Luft- und Raumfahrt sogar im Weltall.

Ausgangssituation:

Komplexes Wissen. Im Alltag schwer auffindbar.

- Kritisches Wissen ist personengebunden und verteilt auf wenige Schlüsselpersonen

- Expert:innen werden von Anfragen und E-Mails überrollt und sind schwer verfügbar

- Support- und Vertriebsfragen wandern durch mehrere Stationen, bis jemand antworten kann

- Technische Details liegen tief in Datenblättern, Wiki und Entwicklungsdokumenten

- Ohne zentralen Zugang suchen Teams lange oder fragen direkt bei Einzelpersonen nach

- Externe KI-Nutzung birgt Abflussrisiken für interne Informationen

- Viele Nutzer:innen, aber kein einheitlicher KI-Standard im Unternehmen

Wissensbasis für ME-Wissen aufgebaut

Verteiltes Produkt- und Prozesswissen wurde in einer strukturierten Wissensbasis gebündelt. Damit entstehen belastbare Antworten auch dann, wenn Schlüsselpersonen im Tagesgeschäft nicht erreichbar sind. Jede Antwort bleibt nachvollziehbar, weil Quellen verlinkt und schnell prüfbar sind.

- Datenblätter, Website-Inhalte und interne Doku zentral eingebunden

- Wiki und HubSpot-FAQs in ein einheitliches Wissensbild überführt

- Informationen so aufbereitet, dass sie schnell auffindbar sind

- Antworten immer mit Quellenlinks für schnelle Prüfung

- Ergebnis: weniger Nachfragen bei Expert:innen, schnellere Reaktionszeiten

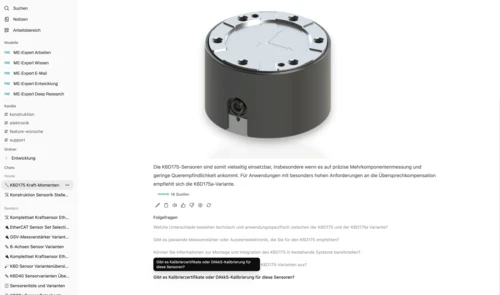

Domainspezifische „Sensors.AI“ getrennt bereitgestellt

Für Sensorik und Messtechnik wurde ein eigener Wissensraum aufgebaut. Diese Wissensbasis ist bewusst vom Alltagswissen getrennt und nur gezielt ansteuerbar. So wird tiefes Entwicklungswissen verfügbar, ohne dass es z.B. in Support-Mails abfließt.

- Fachbücher, Veröffentlichungen und interne Entwicklungspapiere integriert

- Separater Wissensraum getrennt ansteuerbar gemacht

- Nutzung nur bei Bedarf oder in speziellen Agents erlaubt

- Schwerpunkt auf belegbarer, erklärbarer Fachauskunft gelegt

- Ergebnis: starke Unterstützung in Entwicklung, bei klarer Zugriffskontrolle

Highlight

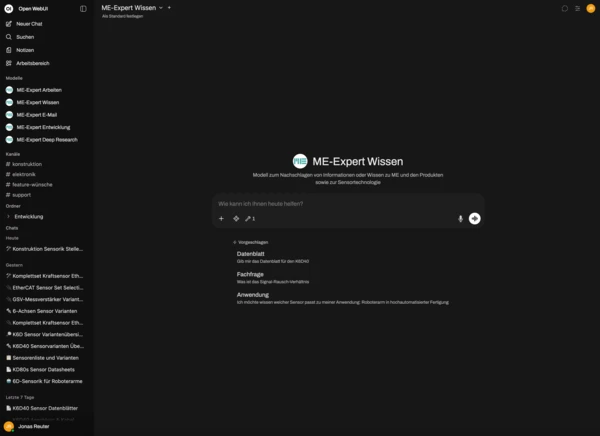

Für über 50 Nutzer:innen: Agenten geben klare Anwendungsfälle vor.

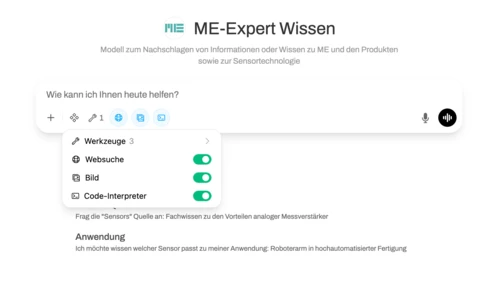

Mehrere Agents sorgen für einen klaren Einstieg je Aufgabe. Mitarbeiter:innen starten sofort im passenden Modus, statt sich durch lange Prompt-Formulierungen zu kämpfen. Das reduziert Fehlbedienung und erhöht die Qualität der Ergebnisse im Alltag.

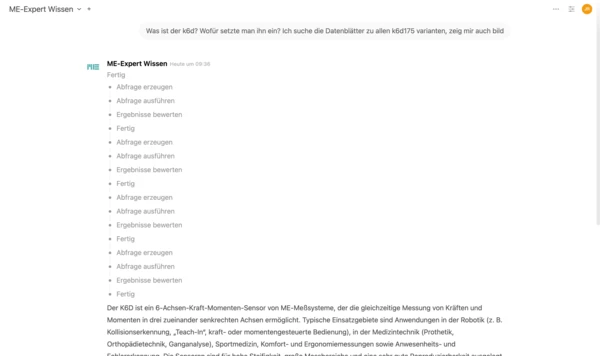

- ME Expert Wissen für das Auffinden von Datenblätter und technischen Details

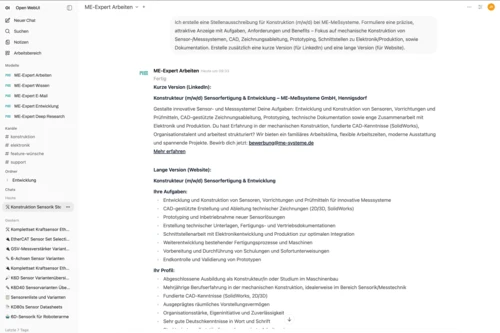

- ME Expert Arbeit für Texte, Briefings und Aufgabenbearbeitung

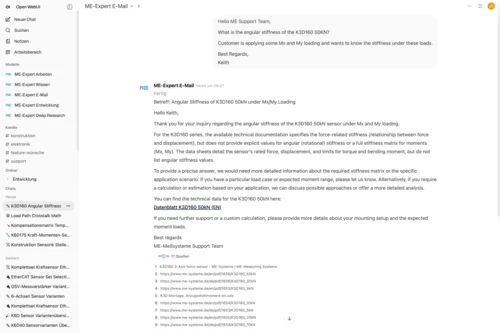

- ME Expert E-Mail für die automatisiere Beantwortung von Kundenanfragen sowie Support

- ME Expert Entwicklung für komplexe Berechnungen sowie R&D

- Zugriffe je Agent auf passende Wissensräume begrenzt

- Ergebnis: weniger Last bei den Experten, schnellere Reaktionszeiten

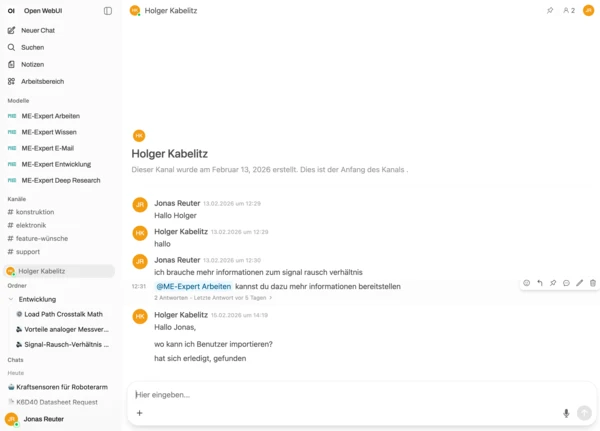

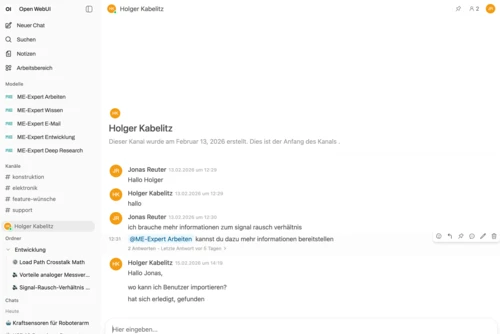

Zusammenarbeit im Chat mit und ohne KI

Channels mit mehreren Mitgliedern ermöglichen Zusammenarbeit im Tool. Ergebnisse bleiben nicht in Einzelchats stecken, sondern können mit Notizen strukturiert abgelegt, geteilt und wiederverwendet werden. Das spart Abstimmungsschleifen und sorgt für mehr Kontinuität im Team.

- Chats automatisch sortiert und in Ordnern organisierbar gemacht

- Chats zwischen Mitarbeiter:innen teilbar gestaltet

- Channels für Coworking&Fachthemen wie Elektronik oder Konstruktion aufgesetzt

- KI kann in Diskussionen gezielt hinzugerufen werden

- Notizen anlegbar und teilbar für wiederkehrende Aufgaben

- Ergebnis: schnelleres Abstimmen, weniger Kontextverlust im Team

Qualität durch Feedback und Nachschärfung gesichert

Jede Antwort kann direkt bewertet werden. So wird sichtbar, wo Wissen fehlt oder Formulierungen nachjustiert werden müssen. Prompts und Wissensbestand werden dadurch gezielt verbessert, statt nur „nach Gefühl“ angepasst zu werden.

- Daumen hoch/runter zur schnellen Bewertung aktiviert

- Schlechte Antworten systematisch analysiert

- Prompts und Agent-Regeln gezielt nachjustiert

- Fehlendes Wissen als Content-Aufgabe identifiziert

- Fokus auf belegte Antworten ohne Zusicherungen gelegt

- Ergebnis: Die KI wird im Betrieb besser, statt nur einmal „ausgerollt“ zu werden. Das reduziert Halluzinationen im Alltag und schafft eine belastbare Grundlage für spätere Automatisierung.

KI-Einsatz sicher skaliert – mit Governance, Zugriffssteuerung und belegbaren Antworten

Der KI-Chat läuft intern und verhindert Datenabfluss in externe Tools oder private Accounts. Rollen, Rechte und Governance-Regeln steuern, wer welche Wissensräume nutzen darf. Vorkonfigurierte Agents geben Orientierung und sorgen für sichere Anwendung im Arbeitsalltag.

- Datenschutzkonforme Bereitstellung / kein Datenabfluss

- Kontroll- und Governance-Möglichkeiten

- Guidance über vorkonfigurierte Agents

- Komplexe Nutzer- und Rechtesteuerung

- Intelligente Retrieval-Logik: mehrere Suchanfragen/Queries pro Frage, liest bei Bedarf viele Quellen (z. B. 5–60)

- Quellenbasierte, „belegbare“ Antworten (Explainable/Traceable: Quellen per Link einsehbar)

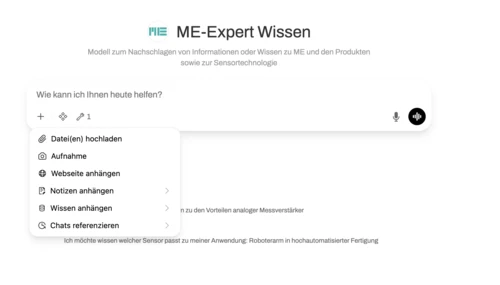

Unzählige weitere Funktionen, die den Alltag spürbar erleichtern

Open WebUI ist nicht nur ein KI-Chat. Es ist eine Arbeitsoberfläche für Wissen, Inhalte und Zusammenarbeit. Neben Recherche und Antworten unterstützt es verschiedene Medienformate, Teamarbeit und Qualitätssteuerung. So wird die KI im Alltag nutzbar, auch für Mitarbeiter:innen ohne KI-Routine, und lässt sich gleichzeitig sauber skalieren und wirtschaftlich betreiben.

- Speech-to-Text (STT) / Inhalte aufsprechen

- Konversation mit der KI (Voice-/Dialog-Interaktion)

- Upload & Verarbeitung von PDFs

- Bildfunktionen (Bilder auslesen, Bilder generieren)

- Internet-Suche (aktivierbar)

- Code-Fähigkeiten (Code erzeugen & interpretieren, je nach Modell/Setup)

- Chat-Organisation & Zusammenarbeit

- Chats sinnvoll benennen, in Ordner verschieben

- Chats zwischen Mitarbeitenden teilen/referenzieren

- Notizen erstellen & teilen

- Channels/Arbeitsräume für Teams (z. B. Konstruktion, Elektronik) inkl. KI „dazuholen“ per Markierung

- Prompt-Assist/Prompt-Rewrite (Unterstützung für Nicht-KI-Natives beim Formulieren)

- Feedback- & Evaluationsmechanismus (Daumen hoch/runter) zur Qualitätsmessung und zum gezielten Nachschärfen von Prompts & Wissensbestand

- Mechanismus für Folgefragen (führt Nutzer durch Themen, triggert erneut Wissensabfragen)

- Skalierbarer Rollout für ca. 50 Mitarbeitende (Pay-per-Use statt viele Einzelaccounts)

- Kostenkontrolle durch nutzungsbasierte Abrechnung statt flächendeckender ChatGPT-/SaaS-Lizenzen

Effizientere Abläufe durch direkten Wissenszugang

Kürzere Reaktionszeiten im Tagesgeschäft

Anfragen landen seltener in internen Weiterleitungsketten. Vertriebs- und Supportteams kommen schneller zu belastbaren Fakten. Das senkt Wartezeiten für Kund:innen und entlastet Expert:innen, weil Standardfragen direkt beantwortet werden.

Anfragen landen seltener in internen Weiterleitungsketten. Vertriebs- und Supportteams kommen schneller zu belastbaren Fakten. Das senkt Wartezeiten für Kund:innen und entlastet Expert:innen, weil Standardfragen direkt beantwortet werden.

Sicherer KI-Einsatz ohne Datenabfluss

Mitarbeiter:innen nutzen einen internen Chat statt verteilter Einzelaccounts. Sensibles Wissen bleibt im Unternehmen und ist je Agent steuerbar. Das schafft Kontrolle über Quellen, Nutzung und Weiterentwicklung der Wissensbasis.

Mitarbeiter:innen nutzen einen internen Chat statt verteilter Einzelaccounts. Sensibles Wissen bleibt im Unternehmen und ist je Agent steuerbar. Das schafft Kontrolle über Quellen, Nutzung und Weiterentwicklung der Wissensbasis.

Mehr Produktivität durch direkten Wissenszugang

Datenblätter, Anschlussbelegungen und technische Spezifikationen sind in Sekunden verfügbar. Teams müssen nicht mehr durch viele Seiten und Dokumente navigieren. Das hilft besonders bei häufigen Fragen und bei neuen Kolleg:innen.

Datenblätter, Anschlussbelegungen und technische Spezifikationen sind in Sekunden verfügbar. Teams müssen nicht mehr durch viele Seiten und Dokumente navigieren. Das hilft besonders bei häufigen Fragen und bei neuen Kolleg:innen.

Der Experten-Chat ermöglicht 50 Mitarbeitern einen einfachen und direkten Zugang zum Unternehmenwissen. Im Unterschied zum "nomalen Business Chat" erlaubt der Experten Chat auch die Erfolgskontrolle der unternehmensweit getätigten Anfragen. Dies ermöglicht perspektivisch die Weiterentwicklung des Chats, z.B. zur automatisierten Beantwortung von emails. Durch die Präsentation aller Quellen werden dem Suchenden auch tief vergrabene Unternehmendokumente präsentiert.

Dr. Holger Kabelitz

Geschäftsführer

MORGEN Leistung

Digitale Prozesse

KI/AI

Unsere Leistung: Interne KI so einführen, dass sie im Alltag wirklich hilft

Erst die echten Engpässe lösen:

KI wird an den Stellen eingesetzt, wo heute Zeit verloren geht. Zum Beispiel bei wiederkehrenden Produktfragen, E-Mail-Pingpong und internen Weiterleitungen. So entsteht spürbare Entlastung statt Show-Projekt.

KI wird an den Stellen eingesetzt, wo heute Zeit verloren geht. Zum Beispiel bei wiederkehrenden Produktfragen, E-Mail-Pingpong und internen Weiterleitungen. So entsteht spürbare Entlastung statt Show-Projekt.

Wissen so aufbereiten, dass es gefunden wird:

Dokumente allein reichen nicht. Inhalte werden so strukturiert, dass die KI die richtigen Stellen findet. Quellen bleiben sichtbar. Damit sind Antworten belastbar und schnell prüfbar.

Dokumente allein reichen nicht. Inhalte werden so strukturiert, dass die KI die richtigen Stellen findet. Quellen bleiben sichtbar. Damit sind Antworten belastbar und schnell prüfbar.

Nutzung vereinfachen statt Prompt-Schulungen:

Vorkonfigurierte Agents geben einen klaren Startpunkt. Mitarbeiter:innen müssen keine perfekten Prompts können. Das sorgt für bessere Ergebnisse und weniger Frust.

Vorkonfigurierte Agents geben einen klaren Startpunkt. Mitarbeiter:innen müssen keine perfekten Prompts können. Das sorgt für bessere Ergebnisse und weniger Frust.

Klare Regeln, damit nichts schiefgeht:

Interner Betrieb verhindert Datenabfluss. Rollen und Rechte steuern, wer welche Bereiche nutzen darf. Sensibles Entwicklungswissen bleibt getrennt. So wird KI nutzbar, ohne Risiko.

Interner Betrieb verhindert Datenabfluss. Rollen und Rechte steuern, wer welche Bereiche nutzen darf. Sensibles Entwicklungswissen bleibt getrennt. So wird KI nutzbar, ohne Risiko.

Qualität im Alltag verbessern, nicht nur einmal testen:

Feedback pro Antwort zeigt, was funktioniert und was fehlt. Daraus werden konkrete Anpassungen an Wissensbestand und Prompts. Die KI wird mit der Nutzung besser.

Feedback pro Antwort zeigt, was funktioniert und was fehlt. Daraus werden konkrete Anpassungen an Wissensbestand und Prompts. Die KI wird mit der Nutzung besser.

Rollout, der bezahlbar bleibt:

Breite Nutzung ist möglich, ohne 50 Einzelaccounts zu kaufen. Abrechnung nach Nutzung hält Kosten im Rahmen. So kann die KI wachsen, wenn der Nutzen wächst.

Breite Nutzung ist möglich, ohne 50 Einzelaccounts zu kaufen. Abrechnung nach Nutzung hält Kosten im Rahmen. So kann die KI wachsen, wenn der Nutzen wächst.